使用 LangChain、LangChain vector store、Mistral AI Pixtral Large 和 Nomic Embed Text V2 构建 RAG 聊天机器人

什么是 RAG

检索增强生成(Retrieval-Augmented Generation,简称 RAG)正引领生成式 AI,尤其是对话式 AI 的新潮流。它将预训练的大语言模型(LLM,如 OpenAI 的 GPT)与存储于向量数据库(如 Milvus、Zilliz Cloud)中的外部知识源相结合,从而让模型输出更准确、更具上下文相关性,并且能够及时融合最新信息。 一个完整的 RAG 系统通常包含以下四大核心组件:

- 向量数据库:用于存储与检索向量化后的知识;

- 嵌入模型:将文本转为向量表示,为后续的相似度搜索提供支持;

- 大语言模型(LLM):根据检索到的上下文和用户提问生成回答;

- 框架:负责将上述组件串联成可用的应用。

核心组件说明

本教程将带你在 Python 环境下,借助以下组件一步步搭建一个初级的 RAG 聊天机器人:

- LangChain: 一个开源框架,帮助你协调大语言模型、向量数据库、嵌入模型等之间的交互,使集成检索增强生成(RAG)管道变得更容易。

- LangChain in-memory vector store: 一个内存型, 临时性 的向量存储,将嵌入数据存储在内存中,并通过精确的线性搜索找到最相似的嵌入。默认的相似度度量是余弦相似度,但可以更改为 ml-distance 支持的任何相似度度量。目前该存储仅适用于演示,不支持 ID 或删除操作。 (如果您需要为应用程序或企业项目提供更具扩展性的解决方案,我们推荐使用 Zilliz Cloud,这是一个基于开源项目 Milvus构建的全托管向量数据库服务,并提供支持最多 100 万个向量的免费套餐。)

- Mistral AI Pixtral Large: 这个高级模型专为高质量的图像和文本生成而设计。凭借其强大的架构,它在创意内容生成、图像增强和多媒体集成等任务中表现出色。Pixtral Large 理想用于营销、设计和娱乐等应用,能够在保持用户友好体验的同时交付令人印象深刻的成果。

- Nomic Embed Text V2: 一个开源的多语言文本嵌入模型,采用混合专家(MoE)架构以实现高效处理。该模型在16亿对文本上进行了训练,擅长于检索任务,支持灵活的嵌入维度,并优化存储和计算成本。其训练数据和代码完全开源,以确保透明性。

完成本教程后,你将拥有一个能够基于自定义知识库回答问题的完整聊天机器人。

注意事项: 使用专有模型前请确保已获取有效 API 密钥。

实战:搭建 RAG 聊天机器人

第 1 步:安装并配置 LangChain

%pip install --quiet --upgrade langchain-text-splitters langchain-community langgraph

第 2 步:安装并配置 Mistral AI Pixtral Large

pip install -qU "langchain[mistralai]"

import getpass

import os

if not os.environ.get("MISTRAL_API_KEY"):

os.environ["MISTRAL_API_KEY"] = getpass.getpass("Enter API key for Mistral AI: ")

from langchain.chat_models import init_chat_model

llm = init_chat_model("pixtral-large-latest", model_provider="mistralai")

第 3 步:安装并配置 Nomic Embed Text V2

pip install -qU langchain-nomic

import getpass

import os

if not os.environ.get("NOMIC_API_KEY"):

os.environ["NOMIC_API_KEY"] = getpass.getpass("Enter API key for Nomic: ")

from langchain_nomic import NomicEmbeddings

embeddings = NomicEmbeddings(model="nomic-ai/nomic-embed-text-v2-moe")

第 4 步:安装并配置 LangChain vector store

pip install -qU langchain-core

from langchain_core.vectorstores import InMemoryVectorStore

vector_store = InMemoryVectorStore(embeddings)

第 5 步:正式构建 RAG 聊天机器人

在设置好所有组件之后,我们来搭建一个简单的聊天机器人。我们将使用 Milvus介绍文档 作为私有知识库。你可以用你自己的数据集替换它,来定制你自己的 RAG 聊天机器人。

import bs4

from langchain import hub

from langchain_community.document_loaders import WebBaseLoader

from langchain_core.documents import Document

from langchain_text_splitters import RecursiveCharacterTextSplitter

from langgraph.graph import START, StateGraph

from typing_extensions import List, TypedDict

# 加载并拆分博客内容

loader = WebBaseLoader(

web_paths=("https://milvus.io/docs/overview.md",),

bs_kwargs=dict(

parse_only=bs4.SoupStrainer(

class_=("doc-style doc-post-content")

)

),

)

docs = loader.load()

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

all_splits = text_splitter.split_documents(docs)

# 索引分块

_ = vector_store.add_documents(documents=all_splits)

# Define prompt for question-answering

prompt = hub.pull("rlm/rag-prompt")

# 定义应用状态

class State(TypedDict):

question: str

context: List[Document]

answer: str

# 定义应用步骤

def retrieve(state: State):

retrieved_docs = vector_store.similarity_search(state["question"])

return {"context": retrieved_docs}

def generate(state: State):

docs_content = "\n\n".join(doc.page_content for doc in state["context"])

messages = prompt.invoke({"question": state["question"], "context": docs_content})

response = llm.invoke(messages)

return {"answer": response.content}

# 编译应用并测试

graph_builder = StateGraph(State).add_sequence([retrieve, generate])

graph_builder.add_edge(START, "retrieve")

graph = graph_builder.compile()

测试聊天机器人

Yeah! You've built your own chatbot. Let's ask the chatbot a question.

response = graph.invoke({"question": "What data types does Milvus support?"})

print(response["answer"])

示例输出

Milvus 支持多种数据类型,包括稀疏向量、二进制向量、JSON 和数组。此外,它还支持常见的数值类型和字符类型,使其能够满足不同的数据建模需求。这使得用户能够高效地管理非结构化或多模态数据。

优化小贴士

在搭建 RAG 系统时,合理调优能显著提升性能与效率。下面为各组件提供一些实用建议:

LangChain 优化建议

为了优化 LangChain,需要通过高效地构建链路和代理来减少工作流程中的冗余操作。使用缓存避免重复计算,从而加快系统速度,并尝试采用模块化设计,确保模型或数据库等组件能够轻松替换。这将提供灵活性和效率,使您能够快速扩展系统,而无需不必要的延迟或复杂性。

LangChain in-memory vector store 优化建议

LangChain 内存型向量存储只是一个临时性的向量存储,它将嵌入数据存储在内存中,并进行精确的线性搜索以找到最相似的嵌入。它的功能非常有限,仅适用于演示。如果您计划构建一个功能完整甚至生产级的解决方案,我们推荐使用 Zilliz Cloud,这是一个基于开源项目 Milvus构建的全托管向量数据库服务,并提供支持最多 100 万个向量的免费套餐。)

Mistral AI Pixtral Large 优化建议

Pixtral Large 是一个高性能的多模态模型,针对文本和图像输入的高级推理进行优化。通过确保高效的文档和图像索引来优化检索,利用混合搜索找到最相关的多模态内容。使用结构化上下文格式化提供检索到的文本和图像之间的清晰关系,防止模型响应中的模糊性。通过动态控制检索深度来调整推理设置——对于复杂的多模态查询获取更广泛的上下文,对于简单查询则专注于更狭窄的、高精度的检索。在将数据传递给模型之前,通过过滤冗余数据来优化令牌效率,以确保推理速度保持高效。对于频繁请求的多模态查询使用缓存,以减少处理开销。如果在生产环境中部署 Pixtral Large,请在多个节点之间分配推理,以有效处理大规模工作负载,同时保持延迟目标。

Nomic Embed Text V2 优化建议

Nomic Embed Text V2 是一个多功能的嵌入模型,适用于 RAG 系统中的通用文本搜索任务。通过预处理输入数据以去除无关噪声并聚焦于最重要的内容,可以优化效率,这有助于减少计算开销。为了实现更快的检索,采用近似最近邻 (ANN) 搜索算法,如 HNSW 或 FAISS,加速搜索过程,同时保持准确性。考虑实施向量量化技术,在不显著影响检索质量的情况下减少存储空间。利用批处理来并行处理多个文本,降低 API 延迟。如果处理大型数据集,定期更新嵌入,以反映最新信息,确保您的检索系统保持相关性和有效性。

通过系统性实施这些优化方案,RAG 系统将在响应速度、结果准确率、资源利用率等维度获得全面提升。 AI 技术迭代迅速,建议定期进行压力测试与架构调优,持续跟踪最新优化方案,确保系统在技术发展中始终保持竞争优势。

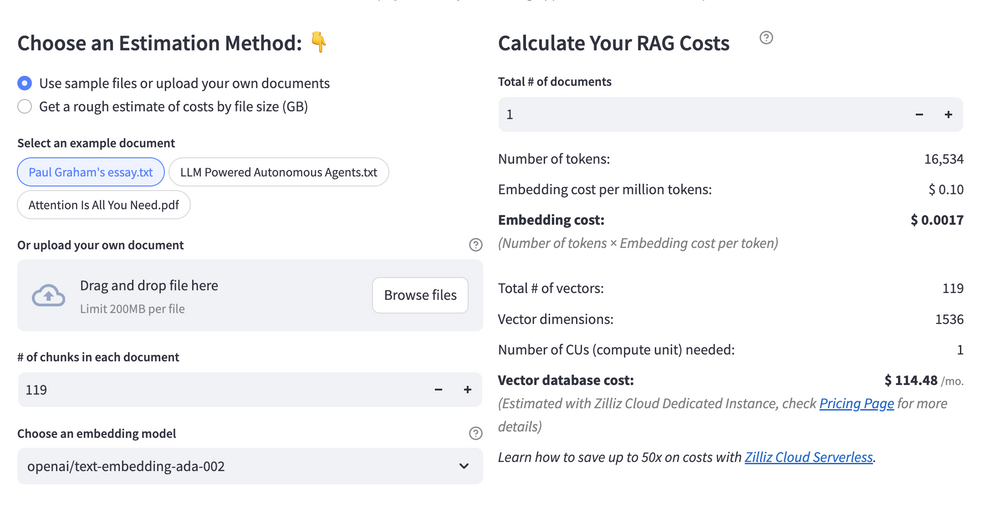

RAG 成本计算器

估算 RAG 成本时,需要分析向量存储、计算资源和 API 使用等方面的开销。主要成本驱动因素包括向量数据库查询、嵌入生成和 LLM 推理。RAG 成本计算器是一款免费的在线工具,可快速估算构建 RAG 的费用,涵盖切块(chunking)、嵌入、向量存储/搜索和 LLM 生成。能帮助你发现节省费用的机会,最高可通过无服务器方案在向量存储成本上实现 10 倍降本。

Calculate your RAG cost

Calculate your RAG cost

收获与总结

恭喜你完成了这个令人兴奋的教程!你刚刚迈出了进入前沿检索增强生成(RAG)系统的巨大一步,通过无缝集成一个强大的框架、一个向量数据库、一个复杂的大语言模型和一个丰富的嵌入模型。让我们花一点时间回顾一下你所学到的内容!

你看到 LangChain 框架如何优雅地将所有这些组件连接起来,提供了一个扎实的结构供你构建。借助 LangChain 向量存储,你可以进行闪电般快速的搜索,在眨眼之间解锁相关信息。接着,Mistral AI Pixtral 大语言模型通过对话智能将这些信息生动呈现,让你能够编写出不仅准确而且引人入胜的响应!与此同时,Nomic Embed Text V2 模型生成深度语义表示,确保你的系统能够理解并传达背景,就像人类一样。

在这个过程中,你还掌握了一些精巧的优化技巧,甚至探讨了一个免费的成本计算器的强大功能,以有效管理你的资源。现在,拥有这些知识,你具备了构建、优化和创新自己 RAG 应用程序的工具!

那么,为什么不开始尝试呢?开始实验,挑战你的创造力,探索无限的可能性。RAG 系统的世界充满潜力,而你现在已经成为其中的一部分!让你的想象力翱翔,谁知道接下来你会创造出什么突破性的解决方案呢!祝你构建愉快!

欢迎反馈!

我们很期待听到你的使用心得与建议! 🌟 你可以:

- 在下方留言;

- 加入 Milvus Discord 社区,与全球 AI 爱好者一起交流。 如果你觉得本教程对你有帮助,别忘了给 Milvus GitHub 仓库点个 ⭐,这将激励我们不断创作!💖