使用 LangChain、LangChain vector store、Mistral AI Ministral 3B 和 OpenAI text-embedding-ada-002 构建 RAG 聊天机器人

什么是 RAG

检索增强生成(Retrieval-Augmented Generation,简称 RAG)正引领生成式 AI,尤其是对话式 AI 的新潮流。它将预训练的大语言模型(LLM,如 OpenAI 的 GPT)与存储于向量数据库(如 Milvus、Zilliz Cloud)中的外部知识源相结合,从而让模型输出更准确、更具上下文相关性,并且能够及时融合最新信息。 一个完整的 RAG 系统通常包含以下四大核心组件:

- 向量数据库:用于存储与检索向量化后的知识;

- 嵌入模型:将文本转为向量表示,为后续的相似度搜索提供支持;

- 大语言模型(LLM):根据检索到的上下文和用户提问生成回答;

- 框架:负责将上述组件串联成可用的应用。

核心组件说明

本教程将带你在 Python 环境下,借助以下组件一步步搭建一个初级的 RAG 聊天机器人:

- LangChain: 一个开源框架,帮助你协调大语言模型、向量数据库、嵌入模型等之间的交互,使集成检索增强生成(RAG)管道变得更容易。

- LangChain in-memory vector store: 一个内存型, 临时性 的向量存储,将嵌入数据存储在内存中,并通过精确的线性搜索找到最相似的嵌入。默认的相似度度量是余弦相似度,但可以更改为 ml-distance 支持的任何相似度度量。目前该存储仅适用于演示,不支持 ID 或删除操作。 (如果您需要为应用程序或企业项目提供更具扩展性的解决方案,我们推荐使用 Zilliz Cloud,这是一个基于开源项目 Milvus构建的全托管向量数据库服务,并提供支持最多 100 万个向量的免费套餐。)

- Mistral AI Ministral 3B: 该模型是一款紧凑而强大的变换器,旨在高效处理自然语言处理任务。它注重速度和较低的计算成本,在文本生成、摘要和分类方面表现出色。非常适合需要在资源受限的环境中获得高性能或要求快速响应时间的应用程序开发者。

- OpenAI text-embedding-ada-002: 这个模型专注于生成高质量的文本嵌入,为各种自然语言处理应用提供强大的工具。它的优势在于语义搜索、聚类和推荐任务。非常适合需要高效且可扩展解决方案的开发者,以理解和处理多种语境中的自然语言数据。

完成本教程后,你将拥有一个能够基于自定义知识库回答问题的完整聊天机器人。

注意事项: 使用专有模型前请确保已获取有效 API 密钥。

实战:搭建 RAG 聊天机器人

第 1 步:安装并配置 LangChain

%pip install --quiet --upgrade langchain-text-splitters langchain-community langgraph

第 2 步:安装并配置 Mistral AI Ministral 3B

pip install -qU "langchain[mistralai]"

import getpass

import os

if not os.environ.get("MISTRAL_API_KEY"):

os.environ["MISTRAL_API_KEY"] = getpass.getpass("Enter API key for Mistral AI: ")

from langchain.chat_models import init_chat_model

llm = init_chat_model("ministral-3b-latest", model_provider="mistralai")

第 3 步:安装并配置 OpenAI text-embedding-ada-002

pip install -qU langchain-openai

import getpass

import os

if not os.environ.get("OPENAI_API_KEY"):

os.environ["OPENAI_API_KEY"] = getpass.getpass("Enter API key for OpenAI: ")

from langchain_openai import OpenAIEmbeddings

embeddings = OpenAIEmbeddings(model="text-embedding-ada-002")

第 4 步:安装并配置 LangChain vector store

pip install -qU langchain-core

from langchain_core.vectorstores import InMemoryVectorStore

vector_store = InMemoryVectorStore(embeddings)

第 5 步:正式构建 RAG 聊天机器人

在设置好所有组件之后,我们来搭建一个简单的聊天机器人。我们将使用 Milvus介绍文档 作为私有知识库。你可以用你自己的数据集替换它,来定制你自己的 RAG 聊天机器人。

import bs4

from langchain import hub

from langchain_community.document_loaders import WebBaseLoader

from langchain_core.documents import Document

from langchain_text_splitters import RecursiveCharacterTextSplitter

from langgraph.graph import START, StateGraph

from typing_extensions import List, TypedDict

# 加载并拆分博客内容

loader = WebBaseLoader(

web_paths=("https://milvus.io/docs/overview.md",),

bs_kwargs=dict(

parse_only=bs4.SoupStrainer(

class_=("doc-style doc-post-content")

)

),

)

docs = loader.load()

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

all_splits = text_splitter.split_documents(docs)

# 索引分块

_ = vector_store.add_documents(documents=all_splits)

# Define prompt for question-answering

prompt = hub.pull("rlm/rag-prompt")

# 定义应用状态

class State(TypedDict):

question: str

context: List[Document]

answer: str

# 定义应用步骤

def retrieve(state: State):

retrieved_docs = vector_store.similarity_search(state["question"])

return {"context": retrieved_docs}

def generate(state: State):

docs_content = "\n\n".join(doc.page_content for doc in state["context"])

messages = prompt.invoke({"question": state["question"], "context": docs_content})

response = llm.invoke(messages)

return {"answer": response.content}

# 编译应用并测试

graph_builder = StateGraph(State).add_sequence([retrieve, generate])

graph_builder.add_edge(START, "retrieve")

graph = graph_builder.compile()

测试聊天机器人

Yeah! You've built your own chatbot. Let's ask the chatbot a question.

response = graph.invoke({"question": "What data types does Milvus support?"})

print(response["answer"])

示例输出

Milvus 支持多种数据类型,包括稀疏向量、二进制向量、JSON 和数组。此外,它还支持常见的数值类型和字符类型,使其能够满足不同的数据建模需求。这使得用户能够高效地管理非结构化或多模态数据。

优化小贴士

在搭建 RAG 系统时,合理调优能显著提升性能与效率。下面为各组件提供一些实用建议:

LangChain 优化建议

为了优化 LangChain,需要通过高效地构建链路和代理来减少工作流程中的冗余操作。使用缓存避免重复计算,从而加快系统速度,并尝试采用模块化设计,确保模型或数据库等组件能够轻松替换。这将提供灵活性和效率,使您能够快速扩展系统,而无需不必要的延迟或复杂性。

LangChain in-memory vector store 优化建议

LangChain 内存型向量存储只是一个临时性的向量存储,它将嵌入数据存储在内存中,并进行精确的线性搜索以找到最相似的嵌入。它的功能非常有限,仅适用于演示。如果您计划构建一个功能完整甚至生产级的解决方案,我们推荐使用 Zilliz Cloud,这是一个基于开源项目 Milvus构建的全托管向量数据库服务,并提供支持最多 100 万个向量的免费套餐。)

Mistral AI Ministral 3B 优化建议

Ministral 3B 是一个轻量级模型,非常适合低延迟、具有成本效益的 RAG 应用。通过限制检索文档的数量来优化检索,确保只有最相关的内容被处理,以保持效率。使用激进的提示压缩技术,例如去除不必要的元数据和以层次结构组织上下文,以最大化信息密度。在进行事实查询时,保持低温度(0.1-0.2),以获得精确且确定的输出。如果同时处理多个请求,请使用高效的批处理机制以减少 API 调用开销。利用量化技术进一步减少内存占用并提高推理速度。对于频繁访问的查询,利用缓存来最小化冗余处理,并在高吞吐量环境中增强响应时间。

OpenAI text-embedding-ada-002 优化建议

OpenAI text-embedding-ada-002以其性能和成本效率的平衡而广受欢迎。在嵌入之前,通过将长文档分割成较小且有意义的块来优化检索,以确保与查询的更好上下文对齐。如果处理大规模嵌入,请实施向量量化以减少内存占用。使用多阶段检索,首先进行初始的ANN搜索,然后进行更精确的过滤或重排序步骤。根据数据更新周期调整索引刷新频率,以维持相关性而不增加过多的计算开销。利用批处理进行嵌入操作,以最小化API延迟。考虑在密集搜索可能失败的边缘案例中使用回退机制,例如基于关键词的检索。

通过系统性实施这些优化方案,RAG 系统将在响应速度、结果准确率、资源利用率等维度获得全面提升。 AI 技术迭代迅速,建议定期进行压力测试与架构调优,持续跟踪最新优化方案,确保系统在技术发展中始终保持竞争优势。

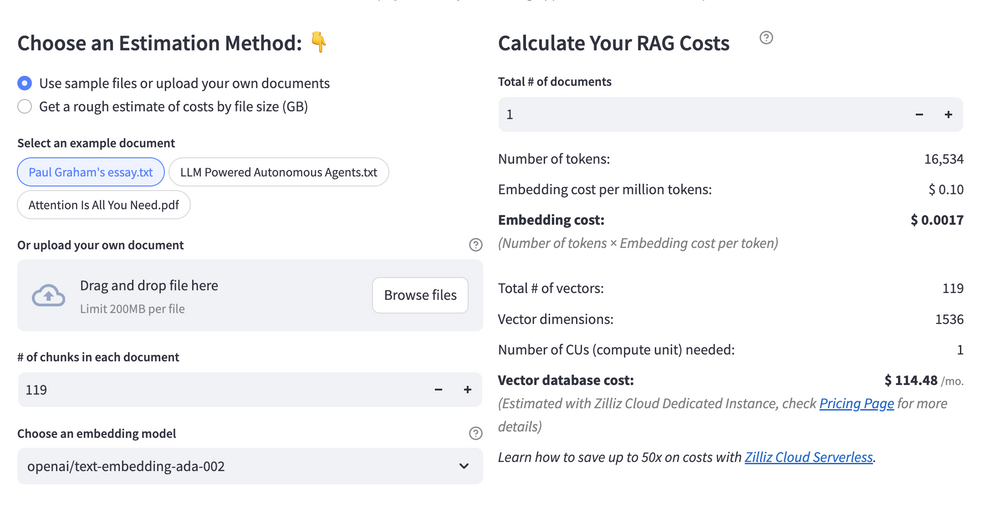

RAG 成本计算器

估算 RAG 成本时,需要分析向量存储、计算资源和 API 使用等方面的开销。主要成本驱动因素包括向量数据库查询、嵌入生成和 LLM 推理。RAG 成本计算器是一款免费的在线工具,可快速估算构建 RAG 的费用,涵盖切块(chunking)、嵌入、向量存储/搜索和 LLM 生成。能帮助你发现节省费用的机会,最高可通过无服务器方案在向量存储成本上实现 10 倍降本。

Calculate your RAG cost

Calculate your RAG cost

收获与总结

你学到了什么?在本教程中,你踏上了一段激动人心的旅程,探索了增强检索生成(RAG)系统的创新领域!通过整合LangChain框架,你见识到它如何无缝地将各种组件结合在一起,以创建一个和谐而高效的解决方案。向量数据库一直是你可靠的伙伴,使你能够进行超快速搜索,轻松检索相关信息,一点也不拖沓。想象一下,这将如何显著改善现实世界应用中的用户体验,这不是令人兴奋吗?

你还解锁了Mistral AI Ministral 3B的对话能力,为你的系统提供了丰富、智能的交互。结合文本嵌入模型text-embedding-ada-002的卓越能力,你可以生成精细的语义表示,完美契合用户查询。这种细致程度使得对上下文的理解比以往任何时候都要深刻!

别忘了那些优化建议和免费的成本计算器!它们将指导你优化RAG系统,最大化效率。

现在,满载知识和实践经验的你,轮到你出击了!深入你的编码环境,运用这些强大的工具,开始构建、优化和创新自己的RAG应用。前景无限,出去让惊人的事情发生吧!

欢迎反馈!

我们很期待听到你的使用心得与建议! 🌟 你可以:

- 在下方留言;

- 加入 Milvus Discord 社区,与全球 AI 爱好者一起交流。 如果你觉得本教程对你有帮助,别忘了给 Milvus GitHub 仓库点个 ⭐,这将激励我们不断创作!💖