G2发布最新向量数据库报告,Zilliz斩获最佳性能与最易用荣誉

进入2025年,大模型已经过了天马行空的许愿阶段,向量数据库同样如此。

一方面,随着上下文窗口的不断增加,以及RAG、agent的普及,大模型已经进入加速落地阶段;

与此同时,与大模型相伴而生的向量数据库、框架、部署平台等生态也进入市场爆发期。其中,仅2023 年 1 月至 2025 年 1 月,关于“向量数据库”的搜索量增加了足足 11 倍。

在这一过程中,关于如何选择合适的向量数据库,如何低成本地使用向量数据库,成了无数开发者关心的重点问题。

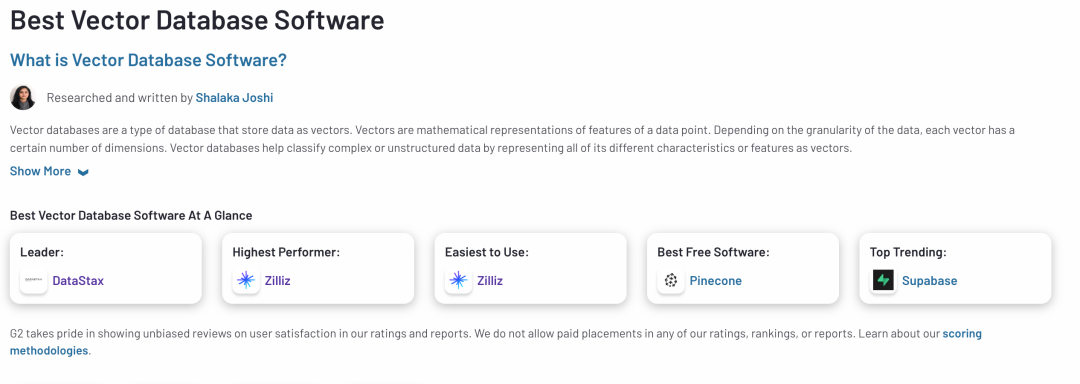

不久前发布的G2 2025 年夏季 Grid® 报告给出了参考。

在这份报告中,比较值得一提的是,通过来自真实用户的认证评价,Zilliz 被评为向量数据库领域的“最佳表现者”和“最易使用者”,拿下双料冠军。

那么,G2 的参考性有什么?Zilliz又凭什么拿下双重认可?本文将做出重点解读。

01 G2的参考性是什么?

与传统给出八大维度,十二大指标的向量数据库评测不同在于,G2 的关注点只有一个,那就是真实用户满意度。因此,无论是大颗粒度的性能、价格、兼容性,还是小颗粒度的版本更新速度、社区反馈,全都同样重要。

因为作为一个大模型时代的全新产品,向量数据库本身仍在高速演进与发展中。因此,一定程度上,所有可以被细化陈列的指标大多是落后指标(当然,这些指标依然有用,也很重要,只是偶尔与现实以及体验脱节)。

举个简单的例子,很多向量数据库的报告,主要看的还是一些古早Benchmark测评数据,但这些Benchmark通常会做出一些不切实际的假设:比如,所有数据默认已经全部导入,索引已经完全建立。但在真实生产中,数据是持续流入的,系统不可能为了一次索引重建就停机几个小时。甚至,还会出现一边是数据持续写入,一边是需要复杂的元数据过滤的情况。

与此同时,这些Benchmark和报告评测的数据集本身也往往是过时的。比如,很多基准测试还在用 SIFT 或 GloVe,但是SIFT 只有 128 维,而 OpenAI、Cohere 的主流模型的embedding模型维度是 768~3072 维,这些数据集的维度远低于当前大模型生成的embedding维度。

再比如,并发测试吞吐量是个很重要的维度,但多数测评方式设定的并发数量和并发机制完全无法测试出database最佳性能。

因此,我们会看到这种现象:各种报告,还有企业都对外宣传自己是毫秒级查询速度,但实际上,就连已经被公认为是成熟产品的Elasticsearch ,只是优化索引的过程就需要 20 多小时,实际生产体验更是差强人意。

类似的评测与生产脱节的案例不胜枚举。因为,要想真实的评估一个向量数据库产品的表现,往往需要将其落到实际生产中,与无数细节较真,比如:怎么从百亿文档查重,怎么细化标签检索,怎么做高效混合检索,磁盘索引能带来多少内存优化,细节往往会直接决定用户的真实使用体验。

但这些看起来不起眼的功能,可能并不会成为主流评测的考量重点。因此,对于新兴行业而言,严谨的报告如forrester非常必要,它可以为行业提供一个框架性的思路指导;但G2这样的更关注细节、更重视实际用户体验的榜单也同样必不可少。

02 为什么是Zilliz?

在G2的这份榜单中,Zilliz是唯一拿下两个top1的厂商,而且被评价为同时兼顾高性能与易用性。

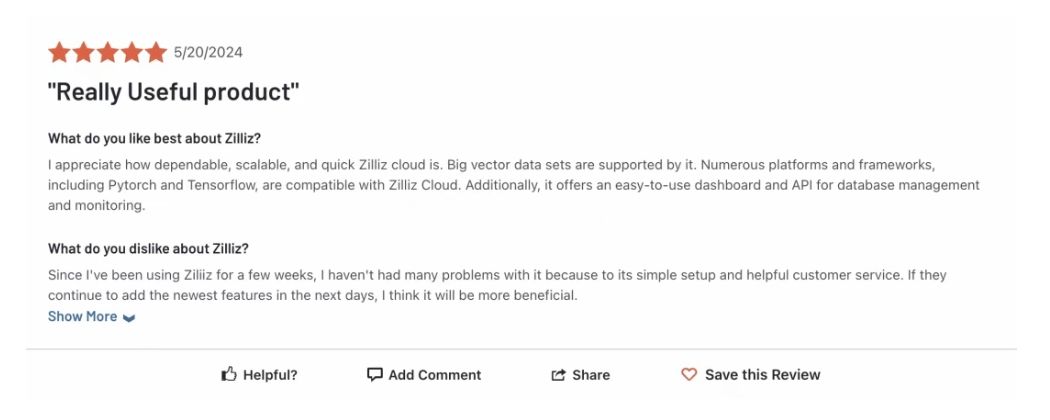

关于高性能,Zilliz Cloud 当下支持的查询速度达到了每秒 50,000 次,延迟可以降低至毫秒级,支持百亿级别的扩展等。此外,Zilliz Cloud还通过 AI 驱动的 Cardinal 搜索引擎和 AUTOINDEX,帮助用户实现更高效的检索,以及自动性能优化等能力。

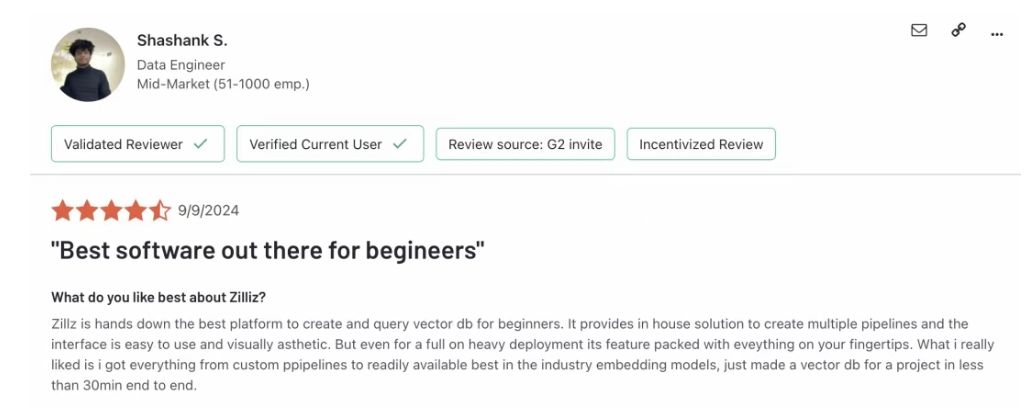

而“最易使用”,则得益于Zilliz Cloud的低维护特性:通常来说,数据库需要专门的团队进行设置和维护;但 Zilliz Cloud可以提供全托管服务,极大降低用户的运维成本。此外, Zilliz Cloud还提供了“易于使用的仪表盘和 API,用于数据库管理和监控”,以及简洁明了的文档体系,便于用户上手。

此外,围绕最易使用,Zilliz Cloud最大的特点就是它完全基于开源 Milvus打造,而Milvus当前已经拥有超过 35,000 个 GitHub star,成为全球最受欢迎的开源向量数据库产品。多数企业可以在使用Zilliz Cloud之前,先用 Milvus 做初步的生产级评估,然后无感迁移Zilliz Cloud。

甚至,对于一些刚入门的小白用户,Zilliz也提供了各种MCP接口,使得用户可以通过大模型快速完成创建集合、语义查询等基础功能,加速业务从0到1的搭建。

当然,Zilliz的优势不止如此。当前Zilliz已经服务了超过 10,000 家企业,包括 Walmart、Salesforce、Nvidia、IBM 和 Roblox 等知名企业,也包括 AI 新兴公司如 Read.AI 和 beatoven.ai,关于Zilliz,他们的使用方式各不相同:

比如博世与Milvus合作,在智能驾驶领域实现数据挖掘革新,降低数据采集成本80%,节约千万元数据存储成本,实现毫秒级检索数十亿数据。

比如滴滴海外创新业务“Grocery Business” 针对超过 3000w 的菜品,采用Milvus打造了一个先进的商超搜索系统,当采用传统搜索无结果或者结果不理想时,系统触发向量搜索作为补充召回,以15%左右的触发率,提升4%的用户添加购物车占比。

比如美国法律独角兽Filevine ,通过Zilliz Cloud构建的RAG系统,打造了一个企业级的法律知识库,平均响应速度比替代方案快 30–50%,服务全球超过 5,000 家律所、70,000+ 用户,处理文档数量高达十亿份。

再比如,哈啰选择Zilliz Cloud构建其RAG系统,并应用于智能客服和内部问答系统。相比Elasticsearch,Milvus在高维数据处理和语义搜索上更优,召回效果好,社区支持强,显著提升了业务效率和用户体验,加速了数字化转型和智能化升级。

这些客户来自不同行业,包括电子商务巨头、金融服务公司、科技巨头、新兴AI企业……但无一例外,他们都是在AI时代高速增长的企业。

尾声

时间维度来看,向量数据库正处于一个高速发展的阶段,新技术层出不穷,最优解决方案仍在不断演进;

从应用广度来看,向量数据库的场景仍在不断横向拓展,从RAG建设、知识库构建,搜索、推荐,再到生物制药、大模型数据管理、自动驾驶数据挖掘,每一个场景都有着完全不同的成本、性能、安全性考量。

尊重复杂性、尊重真实的用户声音,是在这个不断高速膨胀市场里,唯一的制胜秘诀。